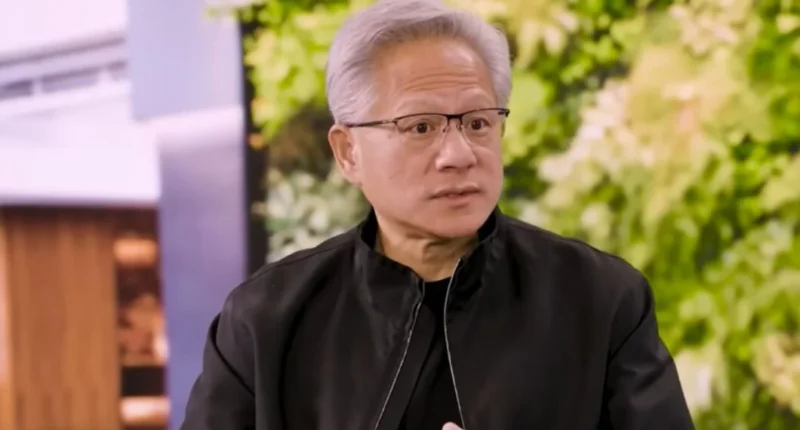

A Inteligência Artificial, tema central de intensos debates globais, tem sido frequentemente alvo de desconfiança e pessimismo. Contudo, para Jensen Huang, CEO da gigante de chips Nvidia, essa narrativa predominantemente negativa não contribui positivamente para o avanço da sociedade, nem para o desenvolvimento tecnológico da IA.

Huang expressou sua profunda preocupação com o que ele chama de ‘narrativa apocalíptica’ sobre a IA, alertando que a ênfase exagerada em cenários catastróficos causa danos concretos ao debate público, afasta investimentos essenciais e pode até mesmo moldar políticas públicas de forma equivocada.

O executivo também direcionou críticas a empresas que, segundo ele, pedem mais regulamentação governamental para a Inteligência Artificial, sugerindo que tais iniciativas nem sempre visam o interesse público. As declarações foram feitas durante sua participação no podcast No Priors.

Danos da ‘Narrativa de Ficção Científica’ sobre a IA

O CEO da Nvidia reconheceu que é simplista descartar completamente as preocupações levantadas por críticos da Inteligência Artificial. No entanto, ele afirmou que algumas posições vêm causando prejuízos significativos ao debate público e ao próprio desenvolvimento tecnológico.

“Eu acho que causamos muitos danos com pessoas muito respeitadas que pintaram uma narrativa apocalíptica, de fim do mundo, de ficção científica”, declarou Huang, enfatizando a gravidade da situação. Ele reforçou a ideia de que, embora muitos tenham crescido gostando de ficção científica, essa abordagem não é útil.

“E eu entendo que muitos de nós crescemos gostando de ficção científica, mas isso não é útil. Não é útil para as pessoas. Não é útil para a indústria. Não é útil para a sociedade. Não é útil para os governos”, argumentou o executivo, destacando os impactos negativos em diversos setores.

Embora não tenha citado nomes diretamente, Huang já teve conflitos públicos com outros executivos que defendem alertas mais severos sobre os impactos da IA. Em 2024, por exemplo, ele discordou abertamente de declarações de Dario Amodei, CEO da Anthropic, que estimou que a Inteligência Artificial poderia eliminar cerca de metade dos empregos administrativos de nível inicial em poucos anos.

Regulação da IA: Interesses Conflitantes?

Durante o podcast, Jensen Huang também foi categórico ao criticar empresas que solicitam mais regulamentação governamental para a IA. Ele sugeriu que essas iniciativas nem sempre colocam o interesse público em primeiro lugar, indicando que pode haver motivações ocultas.

Para o CEO da Nvidia, quando companhias recorrem ao Estado para limitar a tecnologia, há um claro conflito de motivação. Ele acredita que essas ações podem ser guiadas por interesses próprios, e não pelo bem-estar geral da sociedade.

“As intenções deles são profundamente conflitantes e claramente não estão totalmente alinhadas com o melhor interesse da sociedade. Eles são CEOs e estão, obviamente, defendendo a si mesmos”, afirmou Huang, questionando a verdadeira agenda por trás desses pedidos de regulamentação para a Inteligência Artificial.

O Perigo do Excesso de Pessimismo na Inteligência Artificial

O chefe da Nvidia também argumentou que o excesso de mensagens negativas pode, paradoxalmente, acabar criando as próprias consequências que os críticos da IA mais temem. Ele alertou para um ciclo vicioso onde o medo gera estagnação.

“Quando 90% da mensagem gira em torno do fim do mundo e do pessimismo, estamos assustando as pessoas a ponto de afastá-las de investir em IA, investimentos que tornariam a tecnologia mais segura, mais funcional, mais produtiva e mais útil para a sociedade”, explicou Jensen Huang.

Segundo ele, essa aversão ao investimento, causada pelo alarmismo, impede o desenvolvimento de soluções que poderiam tornar a Inteligência Artificial mais benéfica e segura, freando o progresso essencial para o avanço da tecnologia e da sociedade.